Tekst opisuje nowy typ pamięci High Bandwidth Flash (HBF) opracowany przez SK Hynix i SanDisk w ramach Open Compute Project. Jest to pamięć flash o bardzo wysokiej przepustowości, zaprojektowana jako warstwa pośrednia między niezwykle szybką, ale drogą pamięcią HBM, a tradycyjnymi nośnikami SSD w centrach danych.

- Wstęp: po co kolejny typ pamięci w AI?

- Najważniejsze założenia HBF: czym wyróżnia się nowa pamięć?

- Wydajność i pojemność: jak HBF ma „dogonić” i wyprzedzić HBM?

- Roadmapa: kolejne generacje HBF i oszczędność energii

- Integracja z istniejącym sprzętem: zgodność z HBM4 i OCP

- Dlaczego HBF jest szczególnie interesujące dla AI?

- Podsumowanie: co to oznacza dla rynku sprzętu?

HBF ma łączyć wysoką przepustowość, ogromną pojemność i lepszą efektywność energetyczną, co czyni ją szczególnie atrakcyjną dla wnioskowania AI na dużych modelach, gdzie liczy się ilość danych i pobór mocy bardziej niż absolutnie rekordowa szybkość.

Wstęp: po co kolejny typ pamięci w AI?

Skalowanie sztucznej inteligencji przestało być tylko problemem mocy obliczeniowej GPU – coraz większym wyzwaniem jest dostarczenie modelom ogromnych ilości danych przy rozsądnym zużyciu energii i kosztach. Do tej pory rolę „króla wydajności” pełniła pamięć HBM, ale jest ona droga, ma ograniczoną pojemność i wymaga zaawansowanego pakietowania.

Na tym tle pojawia się HBF (High Bandwidth Flash) – pamięć flash o wysokiej przepustowości, która ma stać się nową warstwą w hierarchii pamięci centrów danych: wolniejszą od HBM, ale znacznie pojemniejszą i oszczędniejszą energetycznie niż klasyczne rozwiązania SSD.

Najważniejsze założenia HBF: czym wyróżnia się nowa pamięć?

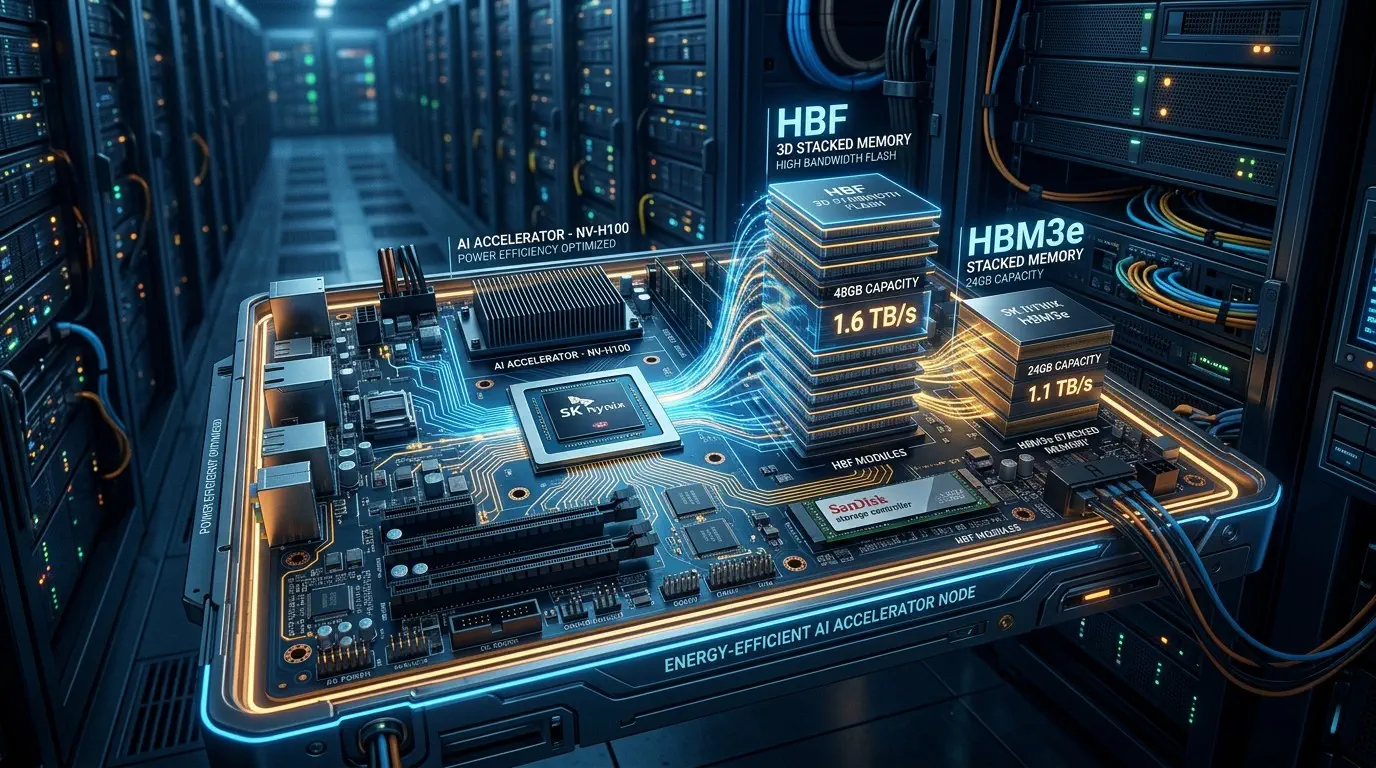

HBF to pamięć oparta na technologii NAND, przygotowana specjalnie dla systemów akceleracji AI. Według twórców ma oferować znacznie większą pojemność niż HBM przy zachowaniu wysokiej przepustowości i dużo niższego zużycia energii.

Kluczowe cechy:

- architektura stosu 3D, która pozwala zmieścić HBF w podobnej przestrzeni fizycznej co moduł HBM4,

- nieulotność – jako pamięć flash HBF przechowuje dane bez potrzeby stałego zasilania,

- pozycjonowanie jako warstwa pośrednia między HBM a SSD w infrastrukturze AI.

To podejście ma rozwiązać problem rosnącej pojemności potrzebnej do obsługi dużych modeli językowych bez eksplozji kosztów i poboru mocy.

Wydajność i pojemność: jak HBF ma „dogonić” i wyprzedzić HBM?

Pierwsza generacja HBF oferuje przepustowość odczytu do 1,6 TB/s oraz stosy złożone z 16 układów, osiągające nawet 512 GB pojemności. Według podanych danych HBF ma mieć od 8 do 16 razy większą pojemność niż HBM w zbliżonych konstrukcjach, co jest kluczowe przy pracy z ogromnymi modelami AI.

W symulacjach z użyciem 8‑bitowego modelu Llama 3.1 405B wydajność konfiguracji z HBF była tylko o 2,2% niższa niż w scenariuszu z HBM o „nieograniczonej pojemności”, co pokazuje, że dla zadań wnioskowania można osiągnąć bardzo zbliżone rezultaty przy zdecydowanie lepszym stosunku wydajności do pojemności.

Roadmapa: kolejne generacje HBF i oszczędność energii

Przedstawiona mapa rozwoju HBF pokazuje, że pierwsza generacja to dopiero początek. Planowane jest, by:

Jednocześnie twórcy zakładają redukcję zużycia energii nawet o 36% w kolejnych wersjach, co w skali dużych klastrów serwerów przekłada się na ogromne różnice w kosztach operacyjnych i chłodzeniu. W świecie, gdzie rachunki za energię są jednym z głównych hamulców rozwoju AI, taki zysk może być równie ważny jak sama wydajność.

Integracja z istniejącym sprzętem: zgodność z HBM4 i OCP

Jednym z atutów HBF jest to, że dzięki stosowi 3D może zajmować tę samą przestrzeń fizyczną co moduł HBM4, co ma ułatwić jej integrację w projektach akceleratorów AI planowanych na lata 2025–2026. Projekt jest rozwijany w ramach Open Compute Project, co ma pomóc w standaryzacji i ułatwić producentom serwerów adopcję rozwiązania na większą skalę.

O sukcesie HBF zdecyduje to, czy stanie się ona powszechnie uznanym standardem – bez tego trudno liczyć na szeroką implementację w sprzęcie wielu dostawców. Rywalizacja będzie zacięta, bo równolegle swoje rozwiązania rozwijają m.in. Samsung i NVIDIA, szukając najlepszego kompromisu między szybkością, pojemnością i zużyciem energii.

Dlaczego HBF jest szczególnie interesujące dla AI?

Trening dużych modeli AI wymaga maksymalnej przepustowości, dlatego tam wciąż króluje HBM. Jednak w wnioskowaniu (inferencji) – czyli etapie, gdy gotowy model odpowiada na zapytania użytkowników – najważniejsze staje się połączenie dużej pojemności pamięci z rozsądną szybkością i niskim poborem mocy.

Tu właśnie HBF ma najwięcej sensu:

- pozwala przechowywać ogromne modele w pamięci bliżej GPU niż zwykłe SSD,

- zużywa mniej energii dzięki nieulotnej naturze flash i zoptymalizowanej architekturze,

- oferuje wydajność bardzo bliską HBM w praktycznych scenariuszach wnioskowania.

W efekcie infrastruktura AI przestaje być wyłącznie wyścigiem na TFLOPS, a coraz bardziej staje się ćwiczeniem z inteligentnego zarządzania pamięcią i energią.

Podsumowanie: co to oznacza dla rynku sprzętu?

Jeśli HBF faktycznie zyska status standardu, może mocno odciążyć HBM i zmienić sposób projektowania akceleratorów AI – zamiast śrubować tylko przepustowość, projektanci dostaną narzędzie do budowy bardziej pojemnych, a przy tym energooszczędnych konfiguracji. Dla dostawców chmur i dużych centrów danych to realna szansa na redukcję kosztów przy rosnącej skali wdrożeń modeli językowych.

Z perspektywy entuzjastów sprzętu to będzie ciekawy przykład, jak pamięć masowa i operacyjna „zlewają się” w nowe hybrydowe warstwy dostosowane do AI. W dłuższej perspektywie takie rozwiązania mogą pośrednio wpłynąć także na rynek kart konsumenckich, bo technologie opracowane dla serwerów często z czasem filtrują się do segmentu pro i high‑end.